– “Alexa, conte uma história.”

O comando por voz às assistentes virtuais no Brasil cresceu substancialmente durante a pandemia e já somos o terceiro País com o maior número de usuários no Google Assistant, apenas para citar um exemplo. Além disso, 37% dos usuários usam o recurso pelo menos três vezes na semana.

Dentre os usuários que utilizam smartphones, quase a metade acessa assistentes de voz no telefone ou em suas casas.

Quando entrevistei a futurista Ligia Zotini para a edição #52 do meu podcast Vieses Femininos, em julho de 2019, falamos sobre liderança e futuro. Na conversamos, falamos sobre como a era da assistência, ou de comandos por voz, se tornaria parte do nosso cotidiano.

O que não é mais tanta novidade é o fato de essas vozes virtuais, como Cortana (Windows), Alexa (Amazon), Siri (Apple), Bia (Bradesco), Cris (Crefisa) e Lu (Magazine Luiza), validarem a força feminina no comando de uma sociedade preocupada com e como “servir às pessoas”.

Faça o exercício de imaginar um futuro (e presente) no qual o feminino está vinculado à assistência e seja honesta(o) comigo: o que te veio à mente?

Falo por mim: minha primeira reação foi com base na construção das minhas [referências machistas de uma sociedade ainda desnorteada](https://www.revistahsm.com.br/post/maternidade-dentro-das-organizacoes-do-sonho-publicitario-a-desilusao-real). “Como assim, as mulheres continuam exercendo uma posição subserviente nesse futuro e presente tecnológico?”

Essa reflexão ainda não foi suficiente para entender o quanto o preconceito de gênero na inteligência artificial faz parte de nossa realidade. Para os pais de crianças que se chamam Alexa nos Estados Unidos e Inglaterra, a voz feminina da Amazon já causa transtornos reais.

Somente no Reino Unido, existem mais de 4 mil pessoas chamadas Alexa com menos de 25 anos. Inclusive, alguns pais contam que professores fazem brincadeiras com o nome e isso tem afetado a saúde mental das crianças.

## Vieses preceituosos em IA

Christian Geronasso, innovation advisor da SAP Brasil, escreveu em janeiro do ano passado sobre os impactos dos [vieses inconscientes de gênero e racial na IA](https://mitsloanreview.com.br/post/dados-podem-estimular-a-equidade-racial). Ele destacou o quão tendenciosa pode ser uma análise de dados quando essa premissa não é considerada.

Ele citou um fato ocorrido em novembro de 2019, quando a Apple passou a oferecer a seus clientes o Apple Card: um cartão de crédito desenhado para consumidores atingirem uma vida financeira mais saudável.

“David, casado com Jamie Heinemeier Hansson, compartilhou em sua conta do Twitter que apesar de sua esposa possuir um melhor score de crédito, de possuírem partes iguais em suas propriedades e de declararem seus impostos de forma conjunta, ele possuía 20 vezes mais crédito para empréstimo que sua esposa. Nem mesmo Steve Wozniak, cofundador da Apple escapou. Wozniak e sua esposa compartilham tudo, desde sua conta bancária até seus ativos, mas o crédito em seu Apple Card era 10 vezes superior ao da sua esposa”, destacou Geronasso.

Em resumo, os impactos dos vieses de gênero na interpretação dos dados são uma realidade.

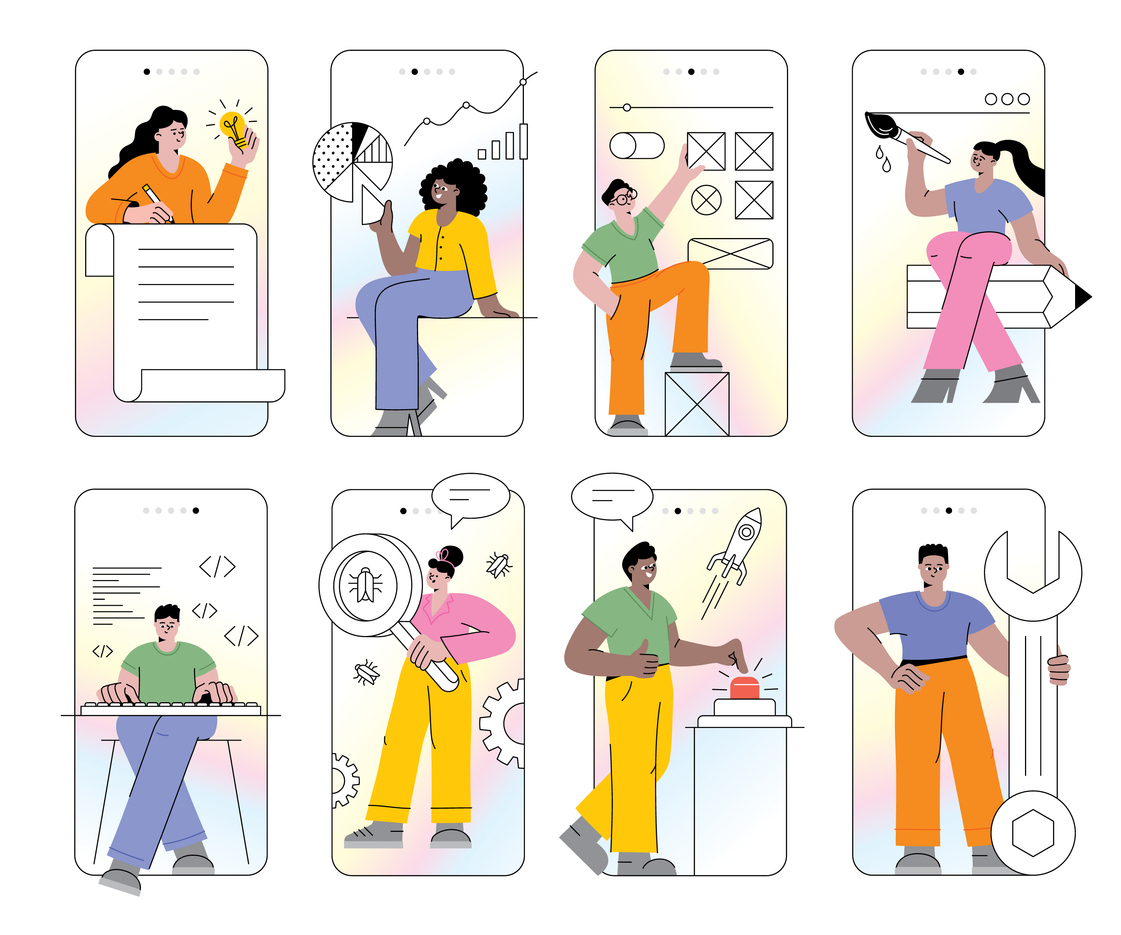

## Pacto global

Para que possamos combater o preconceito de gênero também na IA, e em outros aspectos da tecnologia, a Unesco propõe o desenvolvimento de um instrumento global abrangente: a definição de padrões para fornecer uma base ética e sólida, uma ferramenta que proteja e promove igualmente os direitos e a dignidade humana.

O instrumento será apresentado em novembro aos Estados Membros na Conferência Geral da Unesco, em sua 41ª sessão.

Caso seja mesmo adotado, será uma bússola de orientação ética e um alicerce normativo global que permitirá construir um forte respeito pelo Estado de Direito no mundo digital.

A organização alerta que apenas 22% de todos os profissionais de IA são mulheres. Por [estarem sub-representadas na indústria](https://www.mitsloanreview.com.br/post/como-utilizar-a-ia-para-promover-a-diversidade), os preconceitos de gênero e estereótipos têm sido reproduzidos nas soluções tecnológicas desenvolvidas por quem ainda carrega estes vieses inconscientes.

Se a era da assistência é feminina, se faz urgente que esta linguagem seja praticada não apenas pelos robôs e softwares, mas principalmente por quem os desenvolve.

– “Alexa, desligue.”

*Gostou do artigo da Elisa Tawil? Saiba mais sobre questões éticas no universo corporativo e na indústria 4.0 assinando gratuitamente [nossas newsletters](https://www.revistahsm.com.br/newsletter) e ouvindo [nossos podcasts](https://www.revistahsm.com.br/podcasts) na sua plataforma de streaming favorita*.